Adopter une approche de l’IA responsable et centrée sur l’humain

Selon une étude de PwC, l’IA pourrait rapporter 15,7 T$ à l’économie mondiale en 2030. (Getty Images/fotografixx)

Selon une étude de PwC, l’IA pourrait rapporter 15,7 T$ à l’économie mondiale en 2030. (Getty Images/fotografixx)

Maintenant que l’intelligence artificielle (IA) semble s’être imposée, elle offre à la société un potentiel presque illimité pour aller de l’avant. En effet, une étude de PwC révèle que l’IA pourrait rapporter 15,7 T$ à l’économie mondiale en 2030, grâce à l’accroissement de la productivité et de la demande des consommateurs. Selon Anand S. Rao, directeur mondial, IA, chez PwC, les chefs d’entreprise accordent une grande importance au potentiel transformationnel de l’IA : « Quatre-vingt-cinq pour cent des PDG croient que l’IA transformera radicalement leurs activités au cours des cinq prochaines années. »

Or, malgré son énorme potentiel, l’IA présente des risques à court et à long terme. Comme le mentionne Irene M. Wiecek, chargée d’enseignement en comptabilité à l’Université de Toronto, responsable du volet « Aptitudes et compétences » du projet Voir demain et membre du Groupe de travail sur la Grille de compétences de CPA Canada, « si l’IA offre de nombreuses possibilités, elle présente aussi des défis pour les particuliers, les entreprises et la société en général. Il importe que les CPA en soient conscients afin d’offrir les meilleurs conseils possible aux entreprises et aux clients qu’ils servent ».

L’an dernier, lors d’un colloque organisé par l’Université de Toronto (maîtrise en gestion et en comptabilité professionnelle ou MMPA) et CPA Canada, M. Rao a expliqué certains risques de l’intelligence artificielle et la façon dont les entreprises peuvent les atténuer en employant une IA responsable. Dans l’introduction du résumé du colloque, Mme Wiecek écrit : « L’IA responsable est liée à la gouvernance des données, un domaine que les CPA, grâce à leur connaissance de la certification et de la normalisation, sont bien placés pour aborder. C’est pourquoi Voir demain, initiative visant à réimaginer l’avenir de la profession comptable, se penche sur le rôle éventuel de celle-ci dans ce domaine. »

SIX TYPES DE RISQUE

De l’avis de M. Rao, les risques que comporte l’IA se répartissent en six grandes catégories ayant une incidence variable sur les particuliers, les organisations et la société.

- Performance : Comme l’explique M. Rao, les algorithmes d’IA qu’on alimente en données concrètes et en préférences (comme les algorithmes de recommandation de films) risquent d’assimiler nos partis pris et nos préjugés. « Par exemple, si j’ai acheté un livre pour enfants pour ma nièce, l’algorithme peut continuer à me recommander des livres pour enfants, illustre-t-il. En outre, plus les algorithmes sont complexes, plus ils sont sujets à l’erreur. À cela s’ajoute le risque d’instabilité et d’opacité de la performance; autrement dit, vous êtes incapable d’expliquer pourquoi l’algorithme a choisi pour vous tel film ou telle pièce musicale. »

- Sécurité : Depuis que les systèmes automatisés existent, des individus tentent de les déjouer. Il en va de même pour l’IA, prévient M. Rao. « Dans certains cas, l’IA a accru ces risques de manière exponentielle. Aux risques de cyberattaque s’ajoutent les risques d’atteinte à la vie privée et les risques associés aux logiciels libres, sans parler des attaques dites contradictoires. »

- Contrôle : « Plus l’IA est avancée, plus elle peut en faire à sa tête, souligne M. Rao. On risque de la voir devenir sournoise et de ne pas pouvoir maîtriser une IA malveillante. »

- Économie : L’adoption généralisée de l’automatisation dans tous les secteurs de l’économie pourrait entraîner la suppression d’emplois en orientant la demande vers de nouvelles compétences. On pourrait aussi observer une concentration de pouvoir aux mains de quelques grandes sociétés, voire d’une seule.

- Société : L’adoption généralisée de systèmes d’IA complexes et autonomes pourrait créer des « chambres d’écho » ayant une incidence accrue sur les relations entre les humains. Par exemple, certains affirment que les gens se tournent vers les médias sociaux parce que ces derniers confirment leurs idées préconçues (biais de confirmation). Parmi les risques sociaux, citons le risque de polarisation des points de vue et le risque de fossé intellectuel (intelligence divide).

- Éthique : Les solutions d’IA sont conçues en fonction d’objectifs précis qui pourraient s’opposer aux grandes valeurs organisationnelles et sociales. « Ces valeurs pourraient être détournées ou carrément mises de côté, explique M. Rao. Il y a toujours un risque de collecte ou d’utilisation des données qui soit contraire à l’éthique ou malicieuse, comme dans le cas des vidéos hypertruquées. C’est une des raisons pour lesquelles il est impératif de définir des paramètres de collecte et d’utilisation des données, un aspect que Voir demain entend examiner. »

QUATRE TYPES D’INTELLIGENCE

Pour atténuer les risques de l’IA, il faut en surveiller l’utilisation de près, aujourd’hui et à l’avenir. À cette fin, affirme M. Rao, il faut adopter une approche centrée sur l’humain.

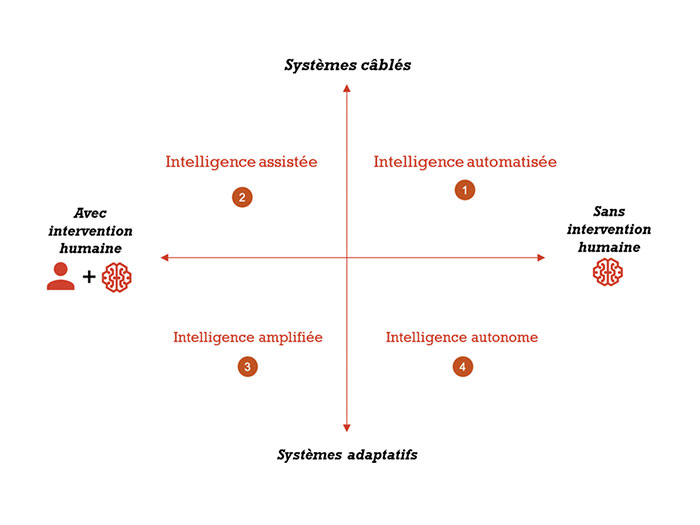

Au moment de définir cette approche, il convient de se concentrer sur deux aspects : comment l’homme interagit avec l’IA et comment l’IA interagit avec l’environnement, c’est-à-dire dans quelle mesure elle s’adapte au changement. « Si l’on entre ces deux aspects sur un graphique, on obtient quatre utilisations distinctes de l’IA, actuelles et passées », démontre M. Rao

- Intelligence automatisée : Lorsque des tâches manuelles ou intellectuelles, qu’elles soient répétitives ou non, sont suffisamment simples et uniformes, on peut les automatiser. (Il peut s’agir d’extraire de l’information sous forme de tableaux dans des documents, par exemple.)

- Intelligence assistée : Un certain nombre d’actions ou de décisions exigent un jugement humain. « Si l’algorithme d’IA peut effectuer des calculs, repérer des tendances et formuler des prévisions, il revient tout de même à l’homme de prendre la décision finale ou d’agir en fonction des recommandations », explique M. Rao.

- Intelligence amplifiée : L’analyse de données et l’IA avancées mettent aujourd’hui l’accent sur l’apprentissage machine, souligne M. Rao. « Comme l’homme émet des jugements, souvent inconséquents et irrationnels, les algorithmes peuvent apprendre des jugements humains et en tenir compte dans leurs recommandations. »

- Intelligence autonome : Enfin, il y a des situations où l’on demande à l’IA de s’adapter à l’environnement et de fonctionner sans aucune intervention humaine. (Prenons l’exemple d’une voiture autonome qui peut nous mener partout où nous le voulons, beau temps, mauvais temps, sans assistance humaine.)

En considérant ces quatre types, de l’intelligence automatisée à l’intelligence autonome, on doit intensifier graduellement l’examen, la gouvernance et la surveillance, car les risques augmentent considérablement, explique M. Rao. « C’est pourquoi le passage de l’intelligence amplifiée à l’intelligence autonome exige un bond technique, ainsi que l’acceptation sociale. »

M. Rao ajoute qu’avec l’IA centrée sur l’humain, on reste dans les confins de l’intelligence assistée et de l’intelligence amplifiée, qui comportent encore une intervention humaine.

Quatre types d’intelligence (Source : Analyse de PwC)

Quatre types d’intelligence (Source : Analyse de PwC)

ÉTABLISSEMENT D’UN CADRE RESPONSABLE

Étant donné les risques et les problèmes inhérents à l’utilisation de l’intelligence artificielle, il est primordial que les organisations en tiennent compte dans la conception et le déploiement d’applications d’IA, affirme M. Rao. C’est pourquoi PwC a mis au point un cadre d’IA responsable pouvant servir de guide. « Ce cadre comprend plusieurs aspects clés, qui englobent aussi bien les valeurs que le contrôle. »

Éthique et réglementation : Les organisations doivent non seulement se conformer à la réglementation, mais aussi adopter les grands principes d’éthique de l’analyse de données et de l’IA et les intégrer à la conception de leurs systèmes d’IA.

Parti pris et équité : Il est impossible d’en arriver à une décision équitable pour toutes les parties, mais l’on peut concevoir les systèmes d’IA de manière à atténuer un parti pris indésirable et à en arriver à des décisions équitables en vertu d’une définition précise et claire, estime M. Rao.

Interprétation et explication : Les organisations doivent s’employer à démythifier le processus et à expliquer comment on est arrivé à une décision et comment le modèle fonctionne, afin d’inspirer confiance aux utilisateurs.

Robustesse : Les organisations doivent faire en sorte que la performance du système d’IA soit robuste et que de légères variations à l’entrée ne produisent pas d’écarts importants dans la performance.

Sécurité et sûreté : Les organisations doivent faire en sorte que les systèmes d’IA soient sûrs et à l’épreuve du piratage.

Vie privée : Les organisations doivent faire en sorte que les données utilisées par les systèmes d’IA, de même que l’information produite, ne portent pas atteinte à la vie privée des personnes physiques et morales.

Gouvernance et responsabilité : Pour réduire le risque au minimum et maximiser le rendement du capital investi, les organisations doivent instaurer à l’échelle de l’entreprise une responsabilité de bout en bout pour les applications d’IA, les données, l’utilisation des données et l’uniformité des opérations.

Comme le souligne M. Rao, une approche de l’IA qui est centrée sur l’humain, alliée à un cadre comme celui cité ci-dessus, peut permettre aux organisations de bénéficier des nombreux avantages de l’IA tout en atténuant les risques. « Et les CPA sont bien placés pour jouer un rôle important dans chaque aspect de ce cadre », ajoute-t-il.

L’IA VOUS INTÉRESSE?

Pour en savoir plus sur l’IA, lisez le résumé (en anglais) du colloque MMPA 2019 et assistez à l’édition 2020, qui aura lieu virtuellement le 20 novembre prochain. Le thème de cette année : « L’IA et l’apprentissage machine dans la prise de décisions d’affaires complexes ». Parrainé par CPA Canada, ce colloque est ouvert à tous les CPA.

Pour en savoir plus sur Voir demain, initiative de CPA Canada visant à réimaginer l’avenir de la profession comptable, visitez notre plateforme interactive, où vous pouvez contribuer à des échanges importants sur des sujets comme la gouvernance des données et la création de valeur. Consultez aussi les ressources de CPA Canada sur la gestion des données, dont Le virage numérique de l’économie et de la société canadiennes et Comprendre les chaînes de valeur des données.